一个通用性更强的GPT-5,对人类而言,既是生产力进步的福音,但同时也是行业大地震的前奏。

从chatGPT问世至今,AI就在以月为单位飞速进化着,其模型之多,迭代之快,让很多人不不禁惊觉:人类似乎真的站在了AGI大门的边缘。

而最近,美国专利商标局 (USPTO) 披露的一份文件显示:OpenAI于7月18日提交了「GPT-5」的商标申请。并且已经被接收。

USPTO 文件截图

尽管在今年上半年,各个AI专家、学者已经多次联合发表公开信,呼吁人们重视生成式 AI 的潜在风险,而OpenAI当时也宣布短期内不会有训练GPT-5的计划。

然而,科技的诱惑,终究还是让人类打破了禁忌的边界。

在这次披露的申请书中,OpenAI提到,尚未发布的GPT-5将具备众多GPT-4所没有的能力,而且几乎每一项都剑指AGI。

USPTO 文件截图

那么,这样的改变,对AI和人类而言,又意味着什么?

今天,本文就将尝试从OpenAI的申请文件中披露的有限信息,对GPT-5可能的功能、变化,及所造成的影响,进行一番简单的剖析。

01 通往AGI之路

在此次披露的文件中,OpenAI最先提到的一个变化,就是多模态功能的加强。

具体来说,GPT-5 的功能包括把文本或语音从一种语言翻译成另一种语言、语音识别、生成文本和语音等。

虽然在现在的GPT-4中,用户同样可以实现不同语种间的翻译,但既然翻译功能在这里被单独挑出来,想必是重新优化过了。

那OpenAI为何会如此突出GPT-5的翻译能力?

这或许是因为,GPT走向通用的前提之一,就是尽可能缩小不同语言使用大模型的成本差距。

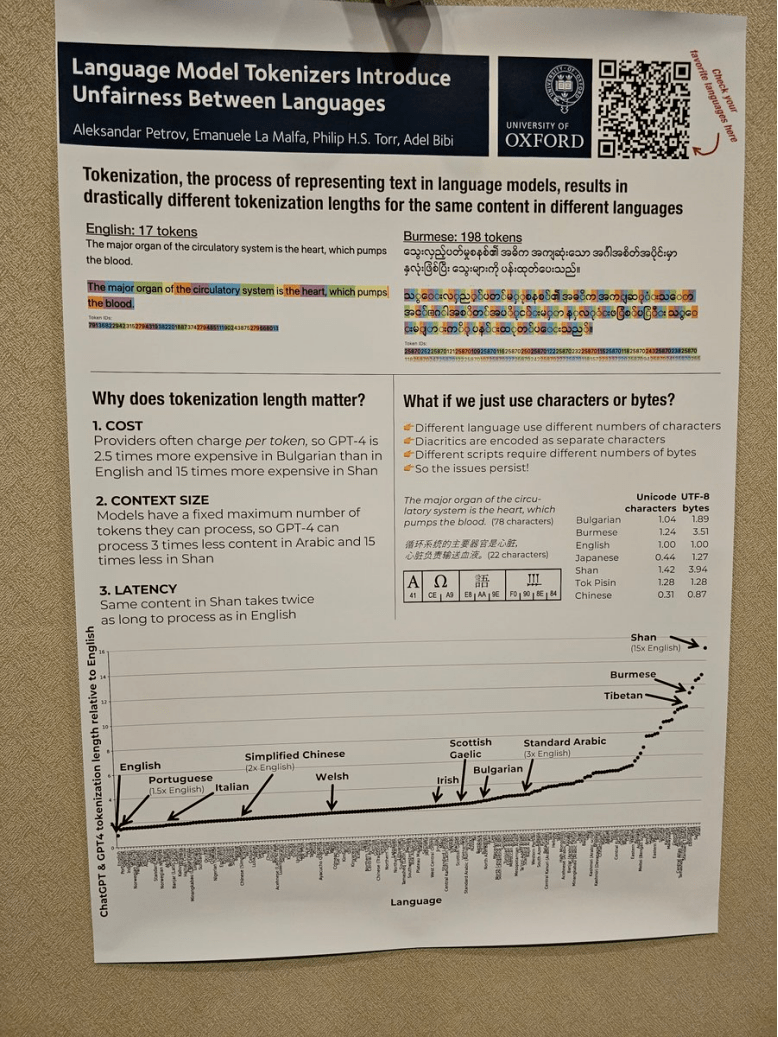

此前,牛津大学的研究成果显示,由于 OpenAI 等服务所采用的服务器成本衡量,和计费的方式的不同,英语输入和输出的费用要比其他语言低得多。

其中简体中文的费用大约是英语的两倍,西班牙语是英语的 1.5 倍,而缅甸的掸语则是英语的 15 倍。

因为像中文这样的语言有着不同、更复杂的结构,导致它们需要更高的词元化率。

例如,根据 OpenAI 的 GPT3 分词器 ,“你的爱意(your affection)” 的词元,在英语中只需要两个词元,但在简体中文中需要八个词元。

这意味着,除了英语之外的其他语言,使用和训练模型要贵得多。

而一旦翻越了“语言障碍”这道槛,无疑会直接地扫清横亘在GPT面前的这条通用性障碍。

除此之外,文件中突出的语音识别功能,看似只是一个不起眼的改动,但从某种程度上说,这也是OpenAI对GPT-5在通往AGI的道路上铺下的又一块路砖。

众所周知,在今后的大模型发展方向上,模型变得边缘化、终端化,已经成了一个愈发明显的趋势。

自从今年7月,高通发布了能在手机上运行的10亿参数大模型后,荣耀、苹果等厂商,也相继宣布要推出自身的“大模型”手机。

以手机为起点,将来的AI数据,将会越来越多地在摄像头、传感器、自动驾驶等终端侧进行处理。

而在这样的应用场景中,语音识别无疑更便捷、高效。

例如,AI语言模型可以让驾驶员可以通过语音控制车辆行驶。将驾驶员的语音指令转化为可执行的指令,例如启动、停止、加速、刹车等操作。

而类似于SIri那样存在于手机系统中的智能助手,也会优先考虑通过语音指令来进行控制。

由此可见,语音识别并非只是锦上添花,而是GPT-5进入终端侧的“标配”,

而通过在这一个个终端设备的下沉,GPT-5也将由此获得更多边缘化的、非语言的数据结构。

毕竟,大模型发展至今,能汲取的文本数据,已经差不多了,要想在通往AGI的路上再上一个台阶,这种“非文本”的数据,就显得至关重要。